- Afhalen na 1 uur in een winkel met voorraad

- Gratis thuislevering in België vanaf € 30

- Ruim aanbod met 7 miljoen producten

- Afhalen na 1 uur in een winkel met voorraad

- Gratis thuislevering in België vanaf € 30

- Ruim aanbod met 7 miljoen producten

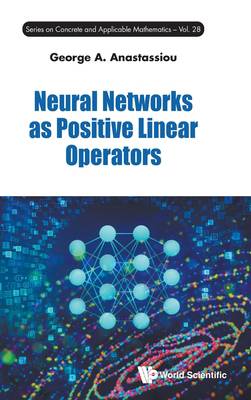

Neural Networks as Positive Linear Operators

Anastassiou George aOmschrijving

This research monograph presents a groundbreaking unification of neural network approximation theory through the lens of Positive Linear Operators (PLOs). For the first time in the literature, neural network operators and activated convolution operators are rigorously analyzed as PLOs - providing a comprehensive, quantitative framework based on inequalities and the modulus of continuity.

The author develops a general, elegant, and highly versatile theory that applies uniformly to a wide variety of neural and convolution operators, bridging Pure and Applied Mathematics with modern Artificial Intelligence and Machine Learning. The results open new directions for mathematical understanding of neural network approximation, with applications across computational analysis, engineering, statistics, and economics.

This volume is an essential resource for mathematicians, computer scientists, and engineers seeking a rigorous analytical foundation for AI and deep learning models.

Specificaties

Betrokkenen

- Auteur(s):

- Uitgeverij:

Inhoud

- Aantal bladzijden:

- 420

- Taal:

- Engels

- Reeks:

Eigenschappen

- Productcode (EAN):

- 9789819826186

- Verschijningsdatum:

- 23/03/2026

- Uitvoering:

- Hardcover

- Formaat:

- Genaaid

- Afmetingen:

- 152 mm x 229 mm

- Gewicht:

- 725 g

Alleen bij Standaard Boekhandel

Beoordelingen

We publiceren alleen reviews die voldoen aan de voorwaarden voor reviews. Bekijk onze voorwaarden voor reviews.