- Afhalen na 1 uur in een winkel met voorraad

- Gratis thuislevering in België vanaf € 30

- Ruim aanbod met 7 miljoen producten

- Afhalen na 1 uur in een winkel met voorraad

- Gratis thuislevering in België vanaf € 30

- Ruim aanbod met 7 miljoen producten

Zoeken

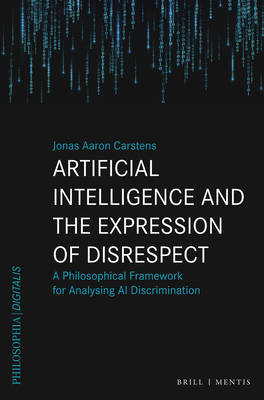

Artificial Intelligence and the Expression of Disrespect

A Philosophical Framework for Analysing AI Discrimination

Jonas Aaron Carstens

€ 97,95

+ 195 punten

Omschrijving

From image recognition that fails to process darker skin to disadvantaging minority neighbourhoods in the credit market, examples of discrimination through artificial intelligence are easy to find, and yet it is unclear why and when such cases are wrong. Jonas Carstens shows that a concept of discrimination built on the expression of disrespect and the social status of those who are disadvantaged can help us make sense of AI discrimination.

AI discrimination sparks moral unease. It poses novel questions and reopens existing debates. What if the programmers of an AI model did not intend any disadvantages, but the model learned discriminatory correlations from the data? Who, if anybody, has discriminated here? Jonas Carstens discusses existing approaches to discrimination, develops a unique synthesis, and uses it to analyse AI discrimination.

AI discrimination sparks moral unease. It poses novel questions and reopens existing debates. What if the programmers of an AI model did not intend any disadvantages, but the model learned discriminatory correlations from the data? Who, if anybody, has discriminated here? Jonas Carstens discusses existing approaches to discrimination, develops a unique synthesis, and uses it to analyse AI discrimination.

Specificaties

Betrokkenen

- Auteur(s):

- Uitgeverij:

Inhoud

- Aantal bladzijden:

- 322

- Taal:

- Engels

- Reeks:

- Reeksnummer:

- nr. 8

Eigenschappen

- Productcode (EAN):

- 9783957433541

- Verschijningsdatum:

- 29/05/2026

- Uitvoering:

- Hardcover

- Formaat:

- Genaaid

- Afmetingen:

- 155 mm x 235 mm

Alleen bij Standaard Boekhandel

+ 195 punten op je klantenkaart van Standaard Boekhandel

Beoordelingen

We publiceren alleen reviews die voldoen aan de voorwaarden voor reviews. Bekijk onze voorwaarden voor reviews.